Roboter lernen zu lernen

Text: Stefan Albus

"Das soll ein Roboter sein?“ Eltern, die ihren Science-Fiction-verliebten Kindern zum ersten Mal einen Industrieroboter zeigen, dürften derartige Fragen kennen. Kein Wunder, erinnern die komplexen Maschinen doch weder an den Kinohelden C3PO des Films Krieg der Sterne noch an die Vorstellungen, die wir uns vielleicht von robotischen Haushaltshilfen der Zukunft machen. Mehr noch: Auch die neuesten Maschinenwesen, die in Fabriken Kunststoffhütchen fein säuberlich auf Tabletts ablegen, sind im Prinzip strunzdumm. Sie lassen die ihnen anvertrauten Plastikteile kommentarlos ins Leere fallen, wenn der Tablett-Nachschub einmal hakt.

Für Forscher wie Nihat Ay und Ralf Der am Leipziger Max-Planck-Institut für Mathematik in den Naturwissenschaften hat das einen einfachen Grund: „Roboter sind heute immer noch sehr stark regelbasierte Systeme“, sagt Ralf Der: Sie arbeiten lediglich vorgegebene Programme ab. Dabei versucht man, ihnen für jede Eventualität eine effektive Antwort vorzuschreiben. Dieser Ansatz macht Roboter im Endeffekt starr.

Inzwischen können hochentwickelte Maschinen aus eigener Kraft Balletttänze aufführen, Treppen steigen und sogar auf Lächeln und Sprache reagieren – aber nur streng nach Programm. Irgendwann scheitern sie daher, denn die Welt ist zu komplex, um sie in ein Regelwerk zu quetschen: Wer etwa einen treppensteigenden Roboter ins Wanken bringen will, muss nur einen Ziegel auf eine Stufe legen. Darum setzen Ingenieure überall da, wo es drauf ankommt – etwa bei Weltraum-Einsätzen –, auf ferngesteuerte Maschinen. Für derart diffizile Missionen wären Roboter nötig, die sich ihrer Umwelt geschickt anpassen. Und Probleme selbstständig lösen.

Genau daran denken Forscher wie Nihat Ay und Ralf Der. Ralf Der: „Man kann Kinder erziehen, indem man ihnen im Detail sagt, was sie machen sollen. Das ist der regelbasierte Ansatz. Man kann aber auch beobachten, was sie am besten können – und das fördern.“

Doch wie soll ein Roboter, der ohne Programme nicht viel mehr ist als ein Haufen Blech, förderungswürdiges Verhalten an den Tag legen? Genau das ist der Irrtum, dem nach Meinung von Der und Ay die Anhänger der sogenannten starken künstlichen Intelligenz (KI) über Jahre aufgesessen sind. Die Lösung verbirgt sich hinter Begriffen wie Selbstorganisation und embodied intelligence.

Biologische Evolution als Vorbild der Roboterschule

Schon seit Jahren nutzen Forscher selbstorganisierende Systeme, um Roboter auf gewisse Aufgaben zu trimmen. Nach Prinzipien aus der biologischen Evolution entwickeln sie seit rund zwei Jahrzehnten Roboter, die hervorragend an einfache Jobs angepasst sind und sich immer besser fortbewegen – zumindest im Rechner. Dennoch bringt die gesteuerte Evolution in Richtung auf ein simples, vorgegebenes Ziel bislang immer noch vergleichsweise einfache Wesen hervor: Zu aufwendig ist das Ausprobieren aller möglichen Mutanten. „Selbst die primitivsten Organismen können immer noch mehr als die besten Roboter“, sagt Der.

Einen weiteren Knacks bekam das Weltbild der Vertreter der regelbasierten KI durch Maschinen wie den passive walker, den eine Arbeitsgruppe am Human Power and Robotics Lab der Cornell University in den 1990er-Jahren vorstellte: ein aus wenigen Röhren und Gelenken zusammengeschweißtes Gestell, das eine schiefe Ebene auf erstaunlich natürlich anmutende Weise hinabschreiten kann – ohne Motoren und vor allem ohne Nervensystem. Auf eine abschüssige Bahn gestellt, fällt ein Bein des Gestells nach vorne und fängt den Fall ab. Diese Bewegung leitet den nächsten Sturz ein, der dann das andere Bein voranbewegt – und so weiter. „Die Konstrukteure haben einfach die in der Konstruktion liegende ‚Intelligenz‘ – ihre embodied intelligence – genutzt“, erklärt Der.

Natürlich bleibt der passive walker im besten Falle stehen, wenn die schiefe Ebene endet. „Aber man könnte ihn ja um Motoren ergänzen, die die Funktion der schiefen Ebene ersetzen“, sagt Der. Also dem Gestell zum richtigen Zeitpunkt immer wieder einen Schubs geben, der einen Fall nach vorne provoziert. „In den Dingen steckt oft eine eigene Klugheit, die man nutzen kann“, so Der. Noch mehr wäre möglich, wenn man die embodied intelligence raffinierter Maschinen mit der modernen Informatik zu einer Art embodied artificial intelligence kombiniert – und das Ganze mit einer gehörigen Portion Selbstorganisation würzt. Genau das haben sich Nihat Ay und Ralf Der in Leipzig vorgenommen.

„Tatsächlich hatten die Vertreter der ‚starken KI‘ lange gedacht, dass es so etwas wie eine vom Körper losgelöste Intelligenz gibt“, sagt Ralf Der: „Wir wissen aber inzwischen, dass so etwas in Reinform nur sehr selten existiert.“ Metaphern wie „da muss es einen Ausweg geben“ zeigen ihm, dass selbst die Suche nach abstrakten Ideen auch mit Vorstellungen aus der physikalischen Welt verbunden ist: „Die Intelligenz hat sich gemeinsam mit dem Körper entwickelt. Beides kann man nicht trennen.“

Maschinen, deren Gehirne sich von selbst entwickeln und dem eigenen Körper anpassen können, zeigt Der auf dem Bildschirm seines Notebooks. Im Video einer virtuellen, aber physikalisch realistisch simulierten Welt rollt eine Walze über eine Ebene, angetrieben von zwei Servomotoren im Innern, die zwei Kugeln auf zwei Achsen hin- und herbewegen. Die Walze rollt erst langsam, dann zunehmend schneller – sie setzt die Kugeln immer effektiver ein. Plötzlich bremst sie ab, um in entgegengesetzter Richtung weiterzurollen. „Nichts davon haben wir vorgegeben. Das Gehirn der Walze probiert selbst aus, welche Möglichkeiten ihr dieser Körper bietet“, erklärt Der.

Nur ein Neuron für jeden Motor

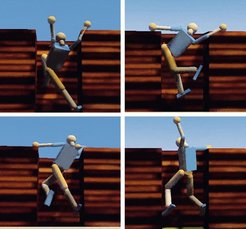

Im nächsten Video sieht man ein Männchen in einem etwa mannshohen Schacht. Es bewegt sich zunächst wie ein betrunkener Breakdancer, aber mit der Zeit gewinnen die Bewegungen an Struktur, wirken immer koordinierter, gezielter. „Das Gehirn dieses Roboters spielt sich sowohl auf seinen Körper als auch auf seine Umgebung ein“, sagt Der. Irgendwann hat das Männchen sogar Bewegungen drauf, mit denen es sich locker aus dem Schacht befreien könnte.

In allen diesen Modellen steckt im Prinzip dasselbe Gehirn: ein Arrangement aus zwei sehr einfachen neuronalen Netzen – einem Controller, der die Motoren ansteuert, und einem Netz, das die Forscher als Selbstmodell bezeichnen. Im Prinzip ist jedem Motor in jedem der beiden Netze lediglich ein Neuron zugeordnet, und doch erzeugt dieser einfache Aufbau – dank Ders ausgetüftelter Algorithmen – verblüffend naturidentisches Verhalten. Allerdings sind die simulierten Männchen nicht gerade schlau. Alles, was sie über sich und ihre Umwelt wissen, erfahren sie über körpereigene Sensoren. Beim Männlein melden diese zum Beispiel die Winkel zwischen den jeweiligen Schenkeln seiner 16 Gelenke – mehr nicht. Das neuronale Controller-Netzwerk empfängt diese Sensorwerte und berechnet daraus Steuersignale für die Motoren.

Das Selbstmodell bekommt die Aufgabe: „Überlege dir, welche Winkel wahrscheinlich zurückgemeldet werden, wenn die Motoren diese Signale ausführen.“ Eine übergeordnete Aufgabe – die sogenannte Lernregel – lautet, vereinfacht gesprochen: „Achte darauf, dass die Diskrepanz zwischen deinen Erwartungen und den gemeldeten Werten so gering wie möglich ist.“ Wenn das Männchen also zum Beispiel versucht, einen Arm über die Elle hinaus zu beugen, wird die Abweichung zwischen Soll und Ist zu groß. Passiert das mehrmals, passt sich das neuronale Netz an – es lernt, dass man den Arm nicht über 180 Grad hinaus beugen kann. Stößt das Männchen mit einer Bewegung immer wieder gegen eine Wand, wird es irgendwann auch diese Erfahrung verinnerlichen.

Allerdings wird sein Gehirn auch schnell wieder vergessen, denn 16 Neuronen können sich nicht sehr viel merken. Trotzdem ist das virtuelle Gespinst in der Lage, allmählich in seinen Körper hineinzuwachsen und ein ganz rudimentäres Bild von sich und seiner Umgebung zu erhalten – und sich entsprechend zu verhalten.

Ein Problem aber gibt es in dieser naiven Fassung: Irgendwann wird auch dem primitivsten dieser Gehirne klar, dass es die Lernregel auch erfüllt, wenn es gar nichts tut – wenn man sich nicht bewegt, ist die Diskrepanz zwischen Vorhersage und Ist-Zustand gleich null. Auf das Rezept gegen diese Depression kam Der durch seine Arbeit als Physiker an der Universität Leipzig. Hier beschäftigte er sich mit den Folgen, die die starre Richtung des Zeitpfeils mit sich bringt.

Ein umgekehrter Zeitpfeil schafft Bewegung

In neuronalen Netzen lässt sich der Zeitpfeil dagegen umkehren. Mit dem Selbstmodell lässt sich eine Dynamik also rückwärts in der Zeit modellieren. Der Controller lernt dann in einer zeitumgekehrten Welt. Natürlich lernt er auch dort, dass Nichtstun die beste Lösung ist. Er wird also auch dort versuchen, Bewegung in Ruhe zu überführen. Aber: „In der realen Welt wird er damit genau das Zeitumgekehrte bewirken, also aus Stillstand Bewegung erzeugen“ – als würde man einen Film, in dem ein rollender Ball zur Ruhe kommt, rückwärts abspielen. Auf diese Weise bleiben die Roboter ständig in Aktion – ohne eine zusätzliche Motivation, wie sie in einem regelbasierten System notwendig wäre.

Um dem Roboter eine zeitumgekehrte Welt vorzugaukeln, lassen die Forscher sein Gehirn aktuelle Sensordaten sammeln. Nun soll es eine Prognose abgeben, welche Werte zu diesem Zustand geführt haben könnten – sie lassen es also praktisch zurück statt nach vorne blicken. Man bringt das Netz also dazu, die aktuellen Messwerte für zukünftige Ereignisse zu halten und daraus die Gegenwart zu ermitteln – und schon ist der Zeitpfeil umgekehrt. Um das Gegenwartsmodell zu testen, muss man die Prognose lediglich mit den bereits vorliegenden Sensorwerten vergleichen. Dann wird das Modell wie gehabt anhand der bekannten Lernregel angepasst.

Dass die derart in die Zukunft geschickten Roboter nun nicht beginnen, sich völlig überdreht zu bewegen, verhindert nun wieder das Selbstmodell: Denn auch wenn das Zusammenspiel der Netze und Motoren von zu chaotischem Tatendrang beherrscht wäre, würden die Sensor-Rückmeldungen oft nicht mehr zu den Prognosen dieses neuronalen Netzes passen. Chaos ist sehr weit von den geordneten Strukturen entfernt, die dieses Modell etablieren muss, um überhaupt eine Prognose entwickeln zu können. Zwischen Chaos und Ruhe liegt aber: mehr oder weniger gerichtete Bewegung.

Ganz nebenbei sorgt das neue Konzept dafür, dass Ders Roboter ganz von alleine immer komplexere Verhaltensweisen an den Tag legen – denn auch wenn die einfacheren Bewegungen gelernt sind und nichts mehr Neues dazukommt, kommt das einem neuronalen Stillstand gleich. Also erweitern die Roboter mit der Zeit ihren Optionsraum, probieren auch Überschläge, Kopfstand und elementare Kletterbewegungen – Verhaltensmuster, die mit regelbasierten Verfahren kaum so elegant zu programmieren wären.

Doch für den Trick mit dem umgekehrten Zeitpfeil wurde noch keine Entsprechung in der belebten Welt gefunden. Wer versucht, die Programmierung von Robotern mit Blick auf natürliche Vorbilder zu erleichtern, muss andere Wege gehen. Hier kommt Nihat Ay ins Spiel, der gemeinsam mit Ralf Der neue Methoden für die embodied artificial intelligence entwickelt. „Die Natur will immer Energie- und Informationsflüsse optimieren“, sagt Ay. „Ein Vogel kann ein Insekt auch deshalb im Flug fangen, weil er seine Muskulatur optimal ansteuert. Die Forscher wollten aus diesem Prinzip eine Lernregel für neuronale Netze ableiten, die Roboter dazu bringt, Verhalten zu entwickeln.

Um diese Idee umzusetzen, nutzen Ay und Der eine Kennzahl – predictive information, PI genannt –, die beschreibt, wie viel Information aus der Vergangenheit für die Vorhersage der Zukunft genutzt werden kann. Ein großer PI-Gradient steht für einen hohen Informationsfluss. Normalerweise leitet man diesen Wert mit langwierigen statistischen Algorithmen aus Zeitreihen ab – nicht zu gebrauchen für Roboter, die schnell lernen sollen.

Ay und Der fanden aber einen Trick: Sie ermitteln einen PI-Schätzwert mithilfe des neuronalen Selbstmodells – das bereits eine ungefähre Idee der zu erwartenden Sensor-Antworten umfasst – also die vom Roboter erwartete Zukunft beschreibt. Dank dieses Zahlenwerts kann das künstliche Gehirn tatsächlich versuchen, den Informationsfluss in der sensomotorischen Schleife – also von und zu den Sensoren und Motoren – zu beziffern, vorherzusagen und zu optimieren. Mit anderen Worten: Das Gehirn versucht sich stets so effektiv zu verhalten wie möglich.

Hoher Informationsfluss macht Roboter neugierig

Das Ergebnis ist vielversprechend. Tatsächlich zeigen erste Analysen, dass die Lernregel „Sorge für einen möglichst hohen Informationsfluss in deiner sensomotorischen Schleife“ in den Simulationsrechnungen zu ähnlichen Verhaltensmustern führt wie der umgedrehte Zeitpfeil. Die Roboter versuchen sich zu bewegen (wachsende PI), ohne hyperaktiv zu werden, denn dann würden Controllerstatus und Vorhersage des Selbstmodells zu weit auseinanderklaffen. Man könnte auch sagen: Die Roboter werden neugierig und versuchen doch, ihre Welt möglichst zuverlässig zu beschreiben.

Um zu sehen, wie diese Gehirne in der richtigen Welt zurechtkommen, muss man ihnen einen richtigen Körper geben. Auch Ralf Der hat längst einen Chip in der Schublade, der nur noch an Sensoren und Motoren angeschlossen werden muss, um sich dort hineinzulernen. „Die Robotik hat den Anspruch, Probleme auf vielen Ebenen zu lösen – von den Lötstellen bis zur Softwarearchitektur“, sagt auch Michael Herrmann, ein langjähriger Kollege und Kooperationspartner Ders, der vor Kurzem vom Max-Planck-Institut für Dynamik und Selbstorganisation in Göttingen zur Universität Edinburgh gefunden hat, wo er über Prothetik und biologische Bewegungssteuerung forscht.

„In anderen Wissenschaften kann man die Grenzbereiche einer vieldimensionalen Wirklichkeit ausblenden. In der Robotik müssen wir uns damit auseinandersetzen“, sagt der Wissenschaftler, der sich mit der Hardwareseite der Robotik bestens auskennt und die beschriebene Lernregel inzwischen in der Neuroprothetik anwendet. Roboter-Konstrukteure müssen ihre Maschinen oft mit beschränkten Mitteln bauen. „Allerdings nutzt auch die belebte Natur mit großem Erfolg Baugruppen, die nicht optimal sind“, meint Herrmann. Der Mensch etwa sei eigentlich nicht für den aufrechten Gang ausgelegt.

Trotz der ungelösten Probleme begegnen wir Robotern bereits im Alltag. Staubsaugern etwa, die sich selbsttätig über den schmutzigen Teppichboden hermachen. Und auch die ersten Autos kämpfen sich in Modellversuchen ohne Fahrer über Wüstenpisten. Man muss sich nur von der Idee humanoider Maschinen verabschieden. Für problematisch hält Michael Herrmann allerdings den hohen Energieverbrauch solcher Maschinen: „Das können wir uns in Zukunft nicht mehr leisten.“

Roboter mit Persönlichkeit

Zurück zu Ders Laptop. Nach etlichen Minuten hat das eingemauerte Männchen eine ganze Menge Bewegungen erlernt, mit denen es sich spielend aus seiner misslichen Lage befreien könnte, tut es aber nicht. Sobald es eine Hand und einen Fuß auf der Mauer hat, findet es offenbar etwas anderes in der Box wieder spannender – und hat dann binnen Kurzem vergessen, dass es ein Draußen gibt. Es verharrt in seiner Gegenwart. Sieht so autonomes, zielgerichtetes Verhalten aus?

„Dafür ist es noch zu früh“, sagt Der. „Wir versuchen Roboter derzeit lediglich dazu zu bringen, sich mit möglichst geringem Aufwand autonom zu verhalten.“ Ay und Der verschaffen Robotern also erst einmal eine Art Körpergefühl. Damit vertreten sie eine der beiden derzeit vorherrschenden Strömungen auf dem Gebiet der KI. Die Anhänger der anderen Richtung versuchen ihre Maschinen darauf zu trimmen, Aufgaben möglichst gut zu lösen – etwa indem sie neuronale Netze für gut erledigte Jobs belohnen. „Wir wollen dagegen erst einmal sehen, was unsere Roboter können, um die Fähigkeiten dann eventuell später zu nutzen“, erklärt Ralf Der – task independent learning heißt das.

Bislang fehlt das Bindeglied zwischen beiden Parteien – die Guidance, also eine übergeordnete Instanz im Roboterhirn, die das erworbene Verhalten bewertet, abspeichert und bei Bedarf wieder hervorholt. Besäße Ders virtuelles Männchen Guidance, könnte es seine Fähigkeiten irgendwann tatsächlich nutzen, um aus seinem Loch zu klettern – oder sich als reales Männchen viel später vielleicht einmal mit einem Arzneipäckchen zu Erdbebenopfern vorzuarbeiten.

Dazu genügt Selbstorganisation alleine nicht. Vielmehr gilt es, ihre produktiven Kräfte zu nutzen, indem man sie sanft in gewünschte Bahnen lenkt. Dieses Ziel verfolgen eine Reihe von Forschern in der Welt; auf einem internationalen Workshop in Sydney stellten sie kürzlich ein Programm zu dessen Verwirklichung auf und vereinbarten entsprechende Kooperationen (The First International Workshop on Guided Self-Organisation, „GSO-2008“). Sie wollen die Gehirne der Roboter mit einem Langzeitgedächtnis ausstatten, das potenziell nützliches Verhalten bereithält und steuernd in das Geschehen eingreift. Erste wegweisende Erkenntnisse dazu hat Georg Martius am Max-Planck-Institut für Dynamik und Selbstorganisation in Göttingen erzielt.

Ralf Der denkt derzeit auch über sogenannte Echo-State-Machines nach, gewissermaßen Konglomerate aus zwei großen Netzwerken, von denen das eine – von einer übergeordneten Ausleseschicht interpretiert – in der Lage ist, auch komplexe Bewegungsabfolgen zwischenzuspeichern.

Nihat Ay und Ralf Der sehen Roboter immer autonomer, lernwilliger, flexibler und natürlicher werden. Für Roboter, die durch Tunnel klettern, auf Planeten eigenständig Experimente machen und vielleicht sogar Alte und Kranke pflegen sollen, sind das unverzichtbare Eigenschaften. Autonome Roboter werden eines Tages auch nicht nur selbstständig Probleme lösen, sondern auch eine Art Persönlichkeit besitzen. „Es ist gut möglich, dass man einzelne Roboter an ihrem Gang erkennen wird – wir können heute schon sehen, dass die Geschichte seines neuronalen Netzes darüber entscheidet, wie sich der Roboter während der Lernphase bewegt“, sagt Ralf Der.

GLOSSAR

Embodied Intelligence

Fähigkeit einer Konstruktion, ihre Bewegungen rein mechanisch zu optimieren.

Embodied Artificial Intelligence

Eine moderne Forschungsrichtung, die „Intelligenz“ einer Konstruktion mit den Methoden der Informatik kombiniert

Controller

Eines der beiden neuronalen Netze, auf denen Embodied Artificial Intelligence basiert: Empfängt Signale der Sensoren und berechnet daraus Steuersignale für den Roboter.

Selbstmodell

Das andere neuronale Netz: prognostiziert, welche Werte die Sensoren messen, wenn die Motoren einen Steuerbefehl ausführen.

Lernregel

Minimiert den Unterschied zwischen prognostizierten Werten des Selbstmodells und den gemessenen des Controllers.