Farbflecken könnten selbst fahrende Fahrzeuge verwirren

Verfahren des maschinellen Lernens, die Bewegungen berechnen, sind anfällig für Störsignale

Ein Forscherteam aus Tübingen zeigt, dass auf tiefen neuronalen Netzen basierende optische Flussalgorithmen – eine wahrscheinliche Komponente zukünftiger autonomer Fahrzeuge – anfällig für Hackerangriffe sind. Die Experten für Maschinelles Sehen und Lernen warnen die Automobilindustrie, dass ein einfaches Farbmuster ausreichen könnte, die Autopiloten in selbstfahrenden Fahrzeugen zu verwirren.

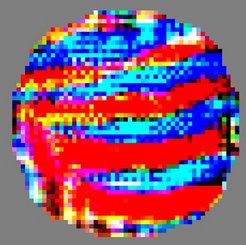

Ein Farbmuster auf einem T-Shirt, als Heckscheibenaufkleber oder als Emblem auf einer Einkaufstüte könnte für selbstfahrende Autos ein Problem darstellen – ein kleines Muster, das so viele Störsignale auslöst, dass es zum Sicherheitsrisiko wird. „Wir haben drei, vielleicht vier Stunden gebraucht, um das Muster zu erstellen – das ging ganz schnell,“ sagt Anurag Ranjan, Doktorand in der Abteilung für Perzeptive Systeme am Max-Planck-Institut für Intelligente Systeme in Tübingen. Er ist der Erstautor der Publikation „Attacking Optical Flow“, ein gemeinsames Forschungsprojekt der Abteilung für Perzeptive Systeme und der Forschungsgruppe für Autonomes Maschinelles Sehen am Tübinger Max-Planck-Institut und der Universität Tübingen.

Die Gefahr, dass aktuell auf dem Markt verfügbare Serienfahrzeuge betroffen sind, ist gering. Dennoch informierten die Forscher vorsichtshalber einige Automobilhersteller, die derzeit selbstfahrende Modelle entwickeln. Sie setzten sie von dem Risiko in Kenntnis, damit sie bei Bedarf zeitnah reagieren können.

Selbstlernende Systeme, die anfällig für Störsignale sind

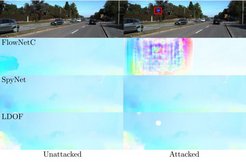

In ihrer Forschungsarbeit prüften Anurag Ranjan und seine Kollegen Joel Janai, Andreas Geiger und Michael J. Black die Robustheit einer Reihe verschiedener Algorithmen zur Bestimmung des sogenannten optischen Flusses. Derartige Systeme werden in selbstfahrenden Autos, in der Robotik, Medizin, bei Videospielen und in der Navigation verwendet, um nur einige wenige Einsatzbereiche zu nennen. Der optische Fluss beschreibt die Bewegung in einer Szene, die von den Bordkameras erfasst wird. Jüngste Fortschritte im Bereich des maschinellen Lernens haben zu schnelleren und besseren Verfahren beim Berechnen von Bewegung geführt. Die Forschung der Tübinger Wissenschaftler zeigt jedoch, dass derartige Verfahren anfällig sind, wenn Störsignale im Spiel sind: zum Beispiel ein einfaches, buntes Muster, das in die Szene platziert wird. Selbst wenn sich das Muster nicht bewegt, kann es dazu führen, dass tiefe neuronale Netze, wie sie heute in großem Maße zur Flussberechnung eingesetzt werden, falsch rechnen: das Netzwerk kalkuliert plötzlich, dass sich große Teile der Szene in die falsche Richtung bewegen.

Mehrmals haben Forscherinnen und Forscher in der Vergangenheit bereits gezeigt, dass selbst winzige Muster neuronale Netze verwirren können. Zum Beispiel wurden dadurch Objekte wie Stoppschilder falsch klassifiziert. Die neue Tübinger Forschungsarbeit zeigt erstmals, dass auch Algorithmen zur Bestimmung der Bewegung von Objekten anfällig für derartige Angriffe sind. Bei der Verwendung in sicherheitskritischen Anwendungen wie in autonomen Fahrzeugen müssen diese Systeme jedoch hinsichtlich derartiger Angriffe „robust“ bzw. zuverlässig und sicher sein.

Selbst ein kleiner Fleck erzeugt große Wirkung

Ranjan und seine Kollegen arbeiten seit März vergangenen Jahres an dem Projekt „attacking optical flow“. Im Zuge ihrer Forschungsarbeit waren sie überrascht, dass selbst ein kleiner Fleck großes Chaos auslösen kann. Es reicht eine Größe von weniger als 1 Prozent des Gesamtbilds aus, um das System anzugreifen. Die kleinste Störung verursachte, dass das System schwere Fehler bei seinen Berechnungen machte, die die Hälfte des Bildbereichs betrafen. Je größer der Fleck, desto verheerender die Auswirkungen. „Dies ist bedenkliche, da das Flow-System in vielen Fällen die Bewegung der Objekten in der gesamten Szene gelöscht hat,“ erklärt Ranjan und weist auf ein Video hin, in dem das angegriffene System zu sehen ist. Man kann sich leicht vorstellen, welchen Schaden ein lahmgelegter Autopilot eines selbstfahrenden Autos bei hoher Geschwindigkeit verursachen kann.

Wie einzelne selbstfahrende Autos funktionieren ist ein wohl-gehütetes Geheimnis der jeweiligen Hersteller. Daher können Computer Vision Grundlagenforscher nur mutmaßen. „Unsere Arbeit soll die Hersteller von selbstfahrender Technologie wachrütteln, sie vor der potenziellen Bedrohung warnen. Wenn sie davon wissen, können sie ihre Systeme so trainieren, dass sie gegenüber derartigen Angriffen robust sind,“ sagt Michael J. Black, Direktor der Abteilung für Perzeptive Systeme am Max-Planck-Institut für Intelligente Systeme.

Möglicherweise ebenso wichtig wie der Hackerangriff selbst ist, dass es den Entwicklerteams der Automobilindustrie zeigt, wie man unter Verwendung einer sogenannten „zero flow“-Prüfung bessere optische Flussalgorithmen entwickeln kann. „Wenn wir dem System zwei identische Bilder zeigen und es keinerlei Bewegung zwischen den beiden gibt, sollte sich der optische Flussalgorithmus farblich überhaupt nicht verändern. Dies ist jedoch oft nicht der Fall, selbst ohne einen Angriff. Schon da fangen also die Probleme an. Hier müssen wir ansetzen, um zu beheben, was das Netz falsch macht“, erläutert Ranjan. Er und sein Team hoffen, dass ihre Forschungsarbeit dazu beiträgt, das Bewusstsein für die Problematik zu stärken, und dass Automobilhersteller derartige Angriffe ernst nehmen und ihre Systeme entsprechend anpassen, um sie weniger störanfällig zu machen.